Message History¶

1. Nombre del Patrón¶

- Nombre oficial: Message History

- Categoría: System Management (Gestión del Sistema de Mensajería)

- Traducción contextual: Historial del Mensaje

2. Resumen Ejecutivo¶

Message History es el patrón que registra la secuencia de componentes por los que pasa un mensaje a medida que viaja a través del sistema de integración. Cada componente que procesa el mensaje añade una entrada a una lista almacenada dentro del propio mensaje, creando un registro progresivo de su ruta — un "diario de viaje" que viaja con el mensaje.

El problema que resuelve es de trazabilidad: en un sistema de integración complejo con múltiples routers, transformers, splitters y endpoints, ¿cómo se determina qué camino siguió un mensaje específico, en qué orden fue procesado y cuánto tiempo pasó en cada componente? Sin Message History, esta información solo puede reconstruirse correlacionando logs de múltiples sistemas — un proceso tedioso, frágil y frecuentemente incompleto. Con Message History, la ruta completa del mensaje está contenida en el propio mensaje.

La vigencia de este patrón es alta. El distributed tracing moderno (OpenTelemetry, Jaeger, Zipkin) es la evolución directa de Message History. Cada span en un trace distribuido es una entrada en el historial de un request. La propagación de trace context (trace ID, span ID, baggage) a través de headers HTTP o messaging headers es el mecanismo moderno de Message History. Los audit logs que registran el procesamiento de documentos regulatorios son otra manifestación.

3. Definición Detallada¶

Propósito¶

Message History proporciona un mecanismo para que cada componente de la cadena de procesamiento registre su participación en el procesamiento de un mensaje. Su propósito es crear un registro completo, auto-contenido y portable de la ruta del mensaje — desde su origen hasta su destino final, pasando por cada componente intermedio.

Lógica Arquitectónica¶

En un sistema de integración complejo, un mensaje puede atravesar múltiples componentes antes de llegar a su destino:

Cada uno de estos componentes puede ser una aplicación diferente, ejecutándose en un servidor diferente, gestionada por un equipo diferente. Cuando algo falla o se comporta inesperadamente, la primera pregunta es: "¿qué camino siguió este mensaje?". Sin Message History, responder esta pregunta requiere:

- Buscar en los logs del productor: ¿cuándo envió el mensaje?

- Buscar en los logs del router: ¿recibió el mensaje? ¿A dónde lo dirigió?

- Buscar en los logs del transformer: ¿procesó el mensaje? ¿Cómo lo transformó?

- Y así sucesivamente para cada componente.

Este proceso asume que todos los componentes loguean con suficiente detalle, que los logs usan un ID de correlación común, que los logs están accesibles y que no hay gaps temporales. En la práctica, alguna de estas condiciones falla.

Message History elimina esta dependencia de logs externos almacenando la ruta directamente en el mensaje. Cada componente añade una entrada con su identificador, timestamp y opcionalmente metadata adicional. Cuando el mensaje llega al destino (o falla en cualquier punto), el historial completo está disponible para inspección.

Principio de Diseño Subyacente¶

El principio es trazabilidad auto-contenida. En lugar de que la información de ruta esté dispersa en logs de múltiples sistemas, la información viaja con el mensaje. Es análogo a un pasaporte: el viajero lleva consigo el registro de todos los países que ha visitado, en lugar de que cada país mantenga su propio registro que luego hay que consultar.

Problema Estructural que Resuelve¶

En sistemas distribuidos, la correlación de eventos a través de múltiples servicios es un problema bien conocido. Message History resuelve este problema para mensajes de integración proporcionando una estructura de datos estándar (la lista de entradas de historial) que cada componente extiende, creando una cadena verificable de procesamiento.

Contexto en el que Emerge¶

Message History emerge cuando el flujo de mensajes es suficientemente complejo (múltiples saltos) y la trazabilidad es un requisito operacional o de compliance. Un flujo simple de dos saltos (productor → consumidor) raramente necesita Message History. Un flujo de 8 saltos con routing condicional y transformaciones lo necesita casi siempre.

Relación con Sistemas Distribuidos¶

Message History es el precursor conceptual del distributed tracing. En la teoría de sistemas distribuidos, corresponde a la noción de causal ordering y happened-before relation de Lamport: cada entrada en el historial establece una relación "este componente procesó el mensaje antes que este otro".

4. Problema que Resuelve¶

El Problema Antes del Patrón¶

Sin Message History, cuando un mensaje produce un resultado inesperado o se pierde:

- Debugging por eliminación: el operador intenta reconstruir la ruta del mensaje consultando logs de cada componente posible, uno por uno.

- Gaps en la cadena: si un componente no logueó el procesamiento del mensaje (o sus logs se purgaron), hay un gap en la cadena de trazabilidad.

- Correlación manual: el operador debe correlacionar entradas de log por timestamp y message ID a través de múltiples sistemas con diferentes formatos de log.

- Ambigüedad en routing: en flujos con routing condicional, no hay forma de saber qué ruta tomó un mensaje específico sin examinar sus datos y las reglas del router.

- Falta de evidencia para compliance: los auditores necesitan prueba de que un mensaje fue procesado por los componentes requeridos en el orden correcto.

Síntomas del Problema¶

- Investigaciones de incidentes que tardan horas porque requieren correlación manual de logs de 6+ sistemas.

- Imposibilidad de determinar si un mensaje fue perdido o simplemente procesado por una ruta diferente a la esperada.

- Auditorías que fallan porque no hay prueba trazable de que los mensajes pasaron por todos los controles requeridos.

- Conversaciones del tipo "yo lo envié" / "yo no lo recibí" entre equipos, sin forma de verificar quién tiene razón.

- SLAs violados sin forma de determinar en qué componente se produjo la latencia.

Impacto Operativo y Arquitectónico¶

- MTTR alto: cada incidente requiere una investigación manual que puede durar horas.

- Confianza reducida: los equipos no confían en que los mensajes se procesan correctamente porque no hay forma de verificarlo.

- Compliance en riesgo: sin trazabilidad verificable, las auditorías son costosas y su resultado incierto.

- Optimización imposible: sin saber cuánto tiempo pasa un mensaje en cada componente, no se puede identificar cuellos de botella.

Riesgos Si No Se Implementa Correctamente¶

- Overhead por historial excesivo: si cada componente añade demasiada metadata al historial, el tamaño del mensaje crece significativamente.

- Historial incompleto: si algunos componentes no implementan Message History, hay gaps que reducen la utilidad del patrón.

- Inconsistencia de formato: si cada componente usa un formato diferente para las entradas de historial, la correlación sigue siendo difícil.

Ejemplos Reales¶

- Logística: una notificación de envío pasa por 7 componentes (validación, enriquecimiento, routing por zona, traducción de formato, deduplicación, entrega al partner, confirmación). Cuando el partner reporta que no recibió la notificación, el historial muestra en qué componente se detuvo.

- Salud: un resultado de laboratorio debe pasar por validación clínica, routing al departamento correcto, y entrega al EMR. El regulador exige prueba de que cada resultado pasó por todos los pasos.

- Finanzas: una orden de pago atraviesa validación de fondos, compliance check, routing interbancario y confirmación. El historial permite reconstruir la cadena completa para auditoría.

5. Contexto de Aplicación¶

Cuándo Usarlo¶

- Cuando los mensajes atraviesan múltiples componentes (3+) y la trazabilidad es importante.

- Cuando los requisitos de compliance exigen prueba de procesamiento por componentes específicos.

- Cuando el debugging de flujos complejos es frecuente y costoso.

- Cuando se necesita medir latencia por componente para optimización.

- Cuando los flujos tienen routing condicional y es importante saber qué ruta tomó cada mensaje.

Cuándo No Usarlo¶

- Cuando el flujo es simple (1-2 saltos) y la trazabilidad puede resolverse con logs correlacionados.

- Cuando el overhead de añadir entries al mensaje es inaceptable (mensajes extremadamente pequeños con throughput extremadamente alto).

- Cuando ya existe un sistema de distributed tracing que captura la misma información de forma externa.

Precondiciones¶

- Todos los componentes del flujo deben implementar el mecanismo de Message History (añadir su entrada al historial).

- El formato de las entradas de historial debe estar estandarizado.

- El mensaje debe tener espacio para transportar el historial (headers, envelope, metadata section).

Restricciones¶

- El tamaño del historial crece con cada salto, lo que incrementa el tamaño del mensaje.

- El historial está limitado por el tamaño máximo de mensaje permitido por la plataforma de mensajería.

- En flujos con fan-out (Splitter, Recipient List), cada copia del mensaje lleva su propio historial que diverge desde el punto de split.

6. Fuerzas Arquitectónicas¶

Trazabilidad vs. Overhead¶

Cada entrada de historial añade bytes al mensaje. En flujos con muchos saltos y mensajes pequeños, el historial puede representar un porcentaje significativo del tamaño total del mensaje. La tensión está entre la completitud de la trazabilidad y el overhead en tamaño y procesamiento.

Información Centralizada vs. Distribuida¶

Message History centraliza la información de ruta en el mensaje (portabilidad), pero la alternativa es centralizar la información en un sistema externo de tracing (OpenTelemetry). La tensión está entre la auto-contención (el mensaje tiene todo lo necesario) y la externalización (un servicio externo tiene la visión completa).

Estandarización vs. Flexibilidad¶

Un formato estandarizado de entradas de historial facilita la lectura y correlación pero puede no capturar toda la metadata relevante de cada componente. Un formato flexible permite metadata rica pero dificulta el procesamiento automatizado.

Completitud vs. Adopción¶

Message History solo es útil si todos los componentes lo implementan. Si el 80% de los componentes añade su entrada pero el 20% no, hay gaps que pueden ser precisamente los puntos donde se necesita trazabilidad. La tensión está entre la utilidad y la barrera de adopción.

Seguridad vs. Transparencia¶

El historial revela la arquitectura interna del sistema (qué componentes existen, en qué orden se ejecutan). Si el mensaje es accesible externamente (por ejemplo, en un sistema de un partner), el historial puede exponer información de arquitectura interna que no debería ser visible.

7. Estructura Conceptual del Patrón¶

Actores o Componentes Involucrados¶

- Mensaje: el portador del historial — transporta la lista de entradas de historial como parte de su estructura.

- Componente del Flujo: cada router, transformer, endpoint u otro componente que procesa el mensaje y añade su entrada al historial.

- History Entry: una entrada individual en el historial — contiene al menos el identificador del componente y el timestamp.

- History Reader: cualquier componente o herramienta que lee el historial para debugging, auditoría u optimización.

Flujo Lógico¶

flowchart LR

A([Productor]) -->|Crea mensaje + historial vacío| B[Productor: añade entrada T1]

B -->|Mensaje con 1 entrada| C[Router: añade entrada T2 + decisión routing]

C -->|Mensaje con 2 entradas| D[Transformer: añade entrada T3]

D -->|Mensaje con 3 entradas| E[Validator: añade entrada T4 + resultado]

E -->|Mensaje con 4 entradas| F[Endpoint: añade entrada final T5 + status]

F -->|Historial completo: 5 entradas| G([Mensaje entregado con ruta, tiempos y decisiones])Responsabilidades¶

| Componente | Responsabilidad |

|---|---|

| Productor | Inicializar la lista de historial con la primera entrada |

| Cada Componente | Añadir su entrada al historial antes de pasar el mensaje |

| History Entry | Contener identificación del componente, timestamp y metadata relevante |

| History Reader | Leer y presentar el historial de forma comprensible |

Decisiones de Diseño Clave¶

- Ubicación del historial: ¿en headers del mensaje, en un envelope wrapper, o en el payload?

- Contenido de cada entrada: ¿solo componente y timestamp, o también decisiones de routing, duración de procesamiento, errores?

- Límite de tamaño: ¿hay un máximo de entradas? ¿Se trunca el historial si excede un tamaño?

- Persistencia: ¿el historial se persiste al final del flujo, o se confía en que el mensaje lo transporta?

- Propagación en fan-out: ¿cómo se maneja el historial cuando un mensaje se divide en múltiples copias?

8. Ejemplo Arquitectónico Detallado¶

Dominio: Logística — Tracking de Notificaciones de Envío¶

Contexto del Negocio¶

Una empresa de logística internacional gestiona 200,000 envíos diarios. Cada cambio de estado de un envío (recogido, en tránsito, en aduana, entregado, devuelto) genera una notificación que debe procesarse a través de múltiples componentes antes de llegar al destinatario final (cliente, partner logístico, sistema de billing).

Las notificaciones de envío pasan por una cadena de procesamiento que varía según el tipo de envío, el destino y el partner:

- Validación: verificar que la notificación contiene todos los campos requeridos.

- Enriquecimiento: añadir datos del contrato (SLA, tarifas) y datos de routing.

- Routing por zona: dirigir al procesador de la zona geográfica correspondiente.

- Traducción de formato: convertir al formato requerido por el partner (EDI, JSON, XML).

- Deduplicación: detectar y eliminar notificaciones duplicadas.

- Entrega al partner: enviar al sistema del partner logístico.

- Confirmación: registrar la confirmación de entrega.

Cuando un partner reporta que no recibió una notificación, o que la recibió con datos incorrectos, el equipo de operaciones necesita reconstruir la ruta exacta del mensaje para determinar en qué punto se produjo el problema.

Necesidad de Integración¶

El equipo necesita trazabilidad completa de cada notificación de envío a través de los 7 componentes de la cadena. La reconstrucción manual a partir de logs tarda 2-4 horas por incidente. Con 15-20 incidentes por semana, el equipo dedica un FTE completo a investigaciones.

Sistemas Involucrados¶

- Shipment Management System (SMS): origen de las notificaciones.

- Validation Service: valida completitud y formato.

- Enrichment Service: añade datos contractuales y de routing.

- Zone Router: dirige al procesador de zona.

- Format Translator: convierte al formato del partner.

- Deduplication Service: elimina duplicados.

- Partner Gateway: envía al sistema del partner.

- Confirmation Service: registra confirmación.

Diseño del Message History¶

Cada mensaje lleva un header X-Message-History que contiene un array JSON de entradas:

{

"headers": {

"X-Message-Id": "NOTIF-2026-0407-184729",

"X-Message-History": [

{

"component": "sms-producer",

"instance": "sms-prod-01",

"timestamp": "2026-04-07T14:32:15.001Z",

"action": "created"

},

{

"component": "validation-service",

"instance": "val-eu-02",

"timestamp": "2026-04-07T14:32:15.045Z",

"action": "validated",

"result": "pass",

"duration_ms": 12

}

]

}

}

Decisiones Arquitectónicas¶

-

Historial en headers de mensaje (no en payload): el historial se almacena como header de Kafka, separado del payload de negocio. Esto evita modificar el schema del payload y permite que componentes que no entienden el historial simplemente lo propaguen.

-

Entradas estandarizadas con extensiones: cada entrada tiene campos obligatorios (

component,timestamp) y campos opcionales por tipo de componente (decisionpara routers,resultpara validators,formatpara translators). -

Persistencia al final del flujo: el Confirmation Service persiste el historial completo en una base de datos de auditoría cuando el mensaje completa su ruta. Esto permite consultas históricas sin acceder a la infraestructura de messaging.

-

Propagación en split: si un mensaje se divide (un envío multi-paquete genera múltiples notificaciones), cada sub-mensaje hereda el historial del padre y añade una entrada de split con referencia al mensaje original.

9. Desarrollo Paso a Paso del Ejemplo¶

Paso 1: Creación de la Notificación¶

El SMS genera una notificación para el envío SHP-2026-EU-184729 (estado: "in_transit", destino: Alemania, partner: DHL Deutschland):

{

"headers": {

"X-Message-Id": "NOTIF-2026-0407-184729",

"X-Message-History": [

{

"component": "sms-producer",

"instance": "sms-prod-01",

"timestamp": "2026-04-07T14:32:15.001Z",

"action": "created",

"shipment_id": "SHP-2026-EU-184729"

}

]

},

"payload": {

"shipment_id": "SHP-2026-EU-184729",

"status": "in_transit",

"destination_country": "DE",

"partner": "DHL-DE"

}

}

Paso 2: Validación¶

El Validation Service recibe el mensaje, verifica los campos requeridos y añade su entrada:

{

"component": "validation-service",

"instance": "val-eu-02",

"timestamp": "2026-04-07T14:32:15.045Z",

"action": "validated",

"result": "pass",

"duration_ms": 12,

"checks": ["required_fields", "country_code_format", "partner_exists"]

}

Paso 3: Enriquecimiento¶

El Enrichment Service añade datos contractuales (SLA de entrega: 48h, tarifa aplicable) y registra su entrada:

{

"component": "enrichment-service",

"instance": "enrich-eu-01",

"timestamp": "2026-04-07T14:32:15.078Z",

"action": "enriched",

"duration_ms": 22,

"fields_added": ["sla_hours", "tariff_code", "routing_zone"]

}

Paso 4: Routing por Zona¶

El Zone Router evalúa el campo destination_country: DE y dirige al procesador de Europa Central:

{

"component": "zone-router",

"instance": "router-eu-01",

"timestamp": "2026-04-07T14:32:15.082Z",

"action": "routed",

"decision": "destination=DE → zone=EU-CENTRAL",

"target_channel": "notifications.eu-central"

}

Paso 5: Traducción de Formato¶

El Format Translator convierte el mensaje de JSON interno a EDI EDIFACT (formato requerido por DHL Deutschland):

{

"component": "format-translator",

"instance": "fmt-eu-central-01",

"timestamp": "2026-04-07T14:32:15.125Z",

"action": "translated",

"source_format": "internal-json",

"target_format": "EDI-EDIFACT-IFTSTA",

"duration_ms": 38

}

Paso 6: Deduplicación¶

El Deduplication Service verifica que no existe una notificación duplicada para el mismo envío y estado:

{

"component": "dedup-service",

"instance": "dedup-eu-01",

"timestamp": "2026-04-07T14:32:15.131Z",

"action": "dedup_check",

"result": "unique",

"lookup_key": "SHP-2026-EU-184729:in_transit"

}

Paso 7: Entrega al Partner y Confirmación¶

El Partner Gateway envía al sistema de DHL y registra la confirmación:

{

"component": "partner-gateway",

"instance": "pgw-dhl-de-01",

"timestamp": "2026-04-07T14:32:15.340Z",

"action": "delivered",

"partner": "DHL-DE",

"protocol": "AS2",

"response_code": 200,

"duration_ms": 195

}

El historial completo (7 entradas) se persiste en la base de datos de auditoría. Tiempo total: 339ms. El operador puede ahora consultar la ruta completa de cualquier notificación en segundos.

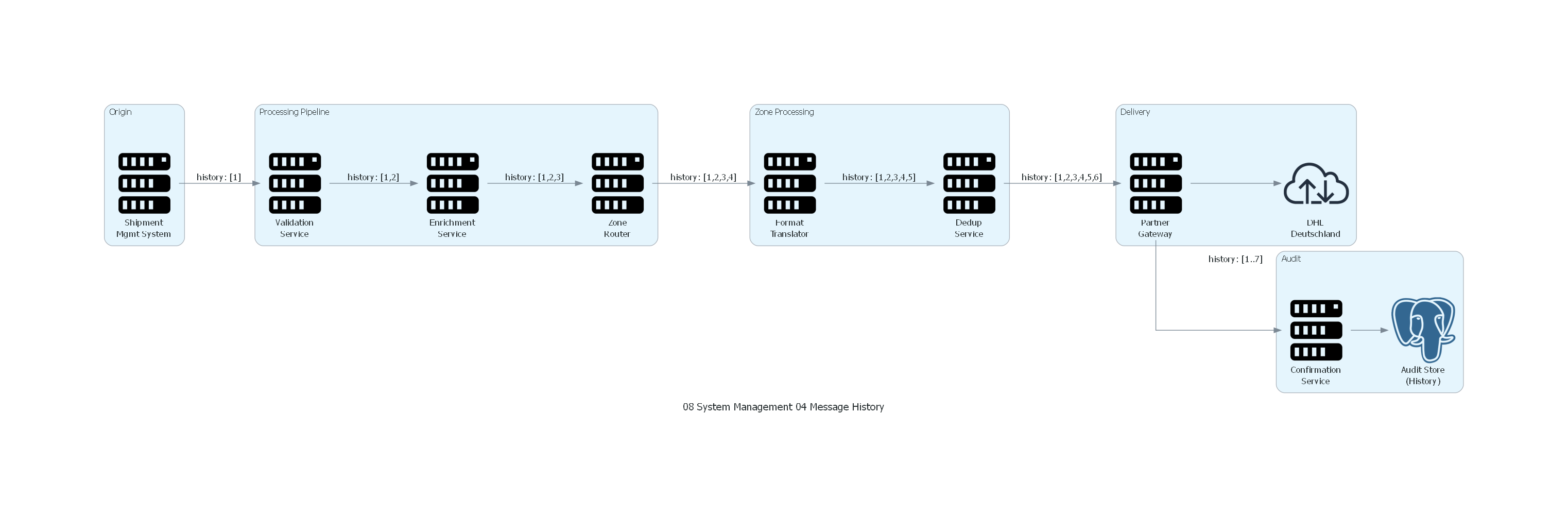

10. Diagrama Técnico del Patrón¶

Código Python con diagrams¶

Ver / Copiar código de los diagramas

from diagrams import Diagram, Cluster, Edge

from diagrams.onprem.queue import Kafka

from diagrams.onprem.compute import Server

from diagrams.onprem.database import PostgreSQL

from diagrams.onprem.network import Internet

with Diagram("Message History - Shipment Notifications", show=False, direction="LR"):

with Cluster("Origin"):

sms = Server("Shipment\nMgmt System")

with Cluster("Processing Pipeline"):

validator = Server("Validation\nService")

enricher = Server("Enrichment\nService")

router = Server("Zone\nRouter")

with Cluster("Zone Processing"):

translator = Server("Format\nTranslator")

dedup = Server("Dedup\nService")

with Cluster("Delivery"):

gateway = Server("Partner\nGateway")

partner = Internet("DHL\nDeutschland")

with Cluster("Audit"):

confirmation = Server("Confirmation\nService")

audit_db = PostgreSQL("Audit Store\n(History)")

# Flow with history accumulation

sms >> Edge(label="history: [1]") >> validator

validator >> Edge(label="history: [1,2]") >> enricher

enricher >> Edge(label="history: [1,2,3]") >> router

router >> Edge(label="history: [1,2,3,4]") >> translator

translator >> Edge(label="history: [1,2,3,4,5]") >> dedup

dedup >> Edge(label="history: [1,2,3,4,5,6]") >> gateway

gateway >> partner

gateway >> Edge(label="history: [1..7]") >> confirmation

confirmation >> audit_db

from diagrams import Diagram, Cluster, Edge

from diagrams.aws.compute import Lambda

from diagrams.aws.database import Dynamodb

from diagrams.aws.integration import StepFunctions, SQS

from diagrams.aws.network import APIGateway

from diagrams.aws.devtools import XRay

with Diagram("Message History - Shipment Notifications (AWS)", show=False, direction="LR"):

with Cluster("Origin"):

sms = Lambda("Shipment\nMgmt System")

xray = XRay("X-Ray\nDistributed Tracing")

with Cluster("Processing Pipeline (Step Functions)"):

validator = Lambda("Validation\nService")

enricher = Lambda("Enrichment\nService")

router = Lambda("Zone\nRouter")

with Cluster("Zone Processing"):

translator = Lambda("Format\nTranslator")

dedup = Lambda("Dedup\nService")

with Cluster("Delivery"):

gateway = APIGateway("Partner\nGateway")

with Cluster("Audit"):

confirmation = Lambda("Confirmation\nService")

audit_db = Dynamodb("Audit Store\n(X-Ray History)")

# Flow with X-Ray trace history accumulation

sms >> Edge(label="history: [1]") >> validator

validator >> Edge(label="history: [1,2]") >> enricher

enricher >> Edge(label="history: [1,2,3]") >> router

router >> Edge(label="history: [1,2,3,4]") >> translator

translator >> Edge(label="history: [1,2,3,4,5]") >> dedup

dedup >> Edge(label="history: [1,2,3,4,5,6]") >> gateway

gateway >> Edge(label="history: [1..7]") >> confirmation

confirmation >> audit_db

sms >> Edge(style="dotted") >> xray

validator >> Edge(style="dotted") >> xray

enricher >> Edge(style="dotted") >> xray

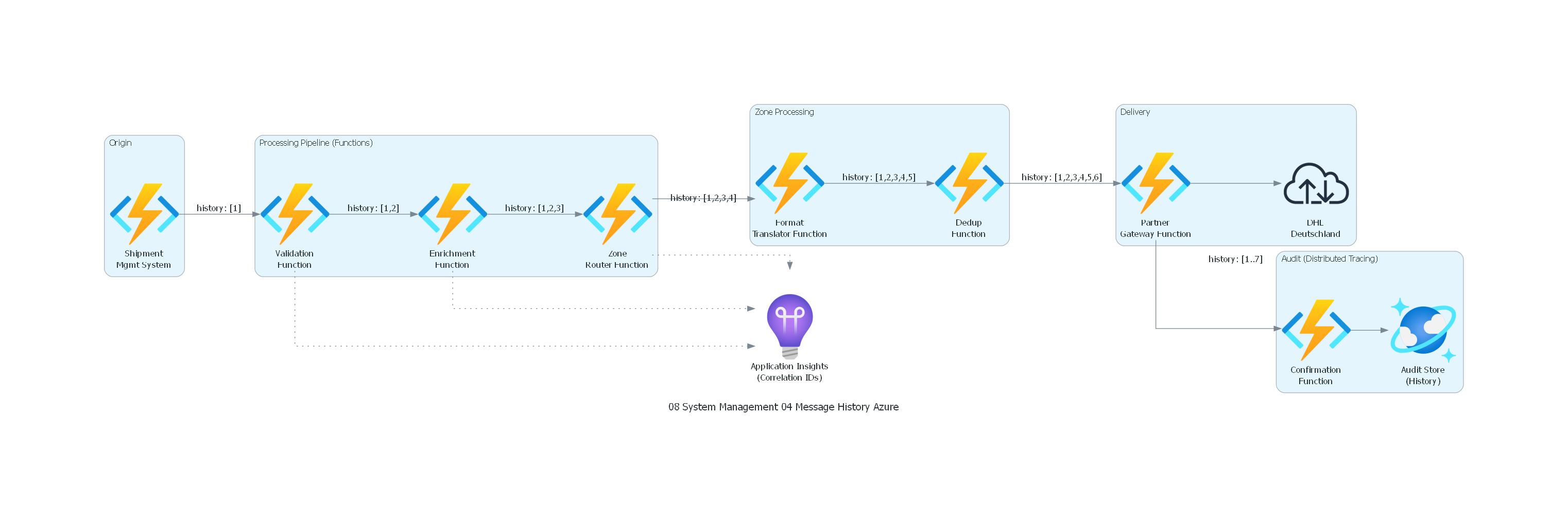

from diagrams import Diagram, Cluster, Edge

from diagrams.onprem.network import Internet

from diagrams.azure.compute import FunctionApps

from diagrams.azure.database import CosmosDb

from diagrams.azure.devops import ApplicationInsights

from diagrams.azure.storage import BlobStorage

with Diagram("Message History - Shipment Notifications (Azure)", show=False, direction="LR"):

with Cluster("Origin"):

sms = FunctionApps("Shipment\nMgmt System")

with Cluster("Processing Pipeline (Functions)"):

validator = FunctionApps("Validation\nFunction")

enricher = FunctionApps("Enrichment\nFunction")

router = FunctionApps("Zone\nRouter Function")

with Cluster("Zone Processing"):

translator = FunctionApps("Format\nTranslator Function")

dedup = FunctionApps("Dedup\nFunction")

with Cluster("Delivery"):

gateway = FunctionApps("Partner\nGateway Function")

partner = Internet("DHL\nDeutschland")

with Cluster("Audit (Distributed Tracing)"):

confirmation = FunctionApps("Confirmation\nFunction")

audit_db = CosmosDb("Audit Store\n(History)")

app_insights = ApplicationInsights("Application Insights\n(Correlation IDs)")

# Flow with history accumulation

sms >> Edge(label="history: [1]") >> validator

validator >> Edge(label="history: [1,2]") >> enricher

enricher >> Edge(label="history: [1,2,3]") >> router

router >> Edge(label="history: [1,2,3,4]") >> translator

translator >> Edge(label="history: [1,2,3,4,5]") >> dedup

dedup >> Edge(label="history: [1,2,3,4,5,6]") >> gateway

gateway >> partner

gateway >> Edge(label="history: [1..7]") >> confirmation

confirmation >> audit_db

validator >> Edge(style="dotted") >> app_insights

enricher >> Edge(style="dotted") >> app_insights

router >> Edge(style="dotted") >> app_insights

Explicación del Diagrama¶

El diagrama muestra cómo el Message History crece progresivamente:

- El SMS crea el mensaje con una primera entrada de historial [1].

- Cada componente sucesivo (Validation, Enrichment, Zone Router, Format Translator, Dedup, Partner Gateway) añade su entrada, haciendo crecer el historial de [1] a [1..7].

- El Confirmation Service persiste el historial completo de 7 entradas en la base de datos de auditoría.

- Las etiquetas de las aristas muestran el crecimiento progresivo del historial.

Correspondencia Patrón ↔ Diagrama¶

| Concepto del Patrón | Componente del Diagrama |

|---|---|

| Mensaje con historial | El mensaje que fluye acumulando entradas en cada arista |

| Componentes del flujo | Validation, Enrichment, Router, Translator, Dedup, Gateway |

| History Entry | Cada número en la lista de historial |

| History Reader | Confirmation Service que persiste y permite consultar |

| Audit Store | PostgreSQL Audit Store |

11. Beneficios¶

Impacto Técnico¶

- Trazabilidad auto-contenida: el mensaje lleva su propia historia. No se necesitan consultas externas para reconstruir la ruta.

- Debugging acelerado: la investigación de un incidente se reduce de horas a minutos — el historial muestra exactamente qué componentes procesaron el mensaje y cuánto tiempo tardó cada uno.

- Detección de cuellos de botella: los timestamps de cada entrada permiten calcular la latencia por componente y detectar dónde se produce la latencia.

- Verificación de ruta: se puede verificar programáticamente que un mensaje pasó por todos los componentes requeridos en el orden correcto.

Impacto Organizacional¶

- Reducción de conflictos entre equipos: cuando un partner dice "no recibí la notificación", el historial provee evidencia objetiva de la ruta del mensaje.

- Compliance verificable: los auditores pueden verificar que cada mensaje pasó por los controles requeridos consultando el historial persistido.

- Autonomía de operaciones: el equipo de operaciones puede diagnosticar problemas sin necesidad de que cada equipo de desarrollo busque en sus logs.

Impacto Operacional¶

- Reducción de MTTR: de 2-4 horas por incidente a minutos.

- Alertas proactivas: se pueden crear alertas cuando un mensaje no tiene las entradas de historial esperadas (indicando que un componente fue bypassed).

- Optimización del flujo: los datos de latencia por componente permiten identificar y optimizar cuellos de botella.

12. Desventajas y Riesgos¶

Complejidad Añadida¶

- Incremento del tamaño del mensaje: cada entrada de historial añade bytes. En flujos largos (10+ saltos) con metadata detallada, el historial puede añadir varios KB al mensaje.

- Adopción universal requerida: el valor del patrón depende de que todos los componentes implementen Message History. Un componente que no lo hace crea un gap.

- Estandarización del formato: todos los componentes deben usar el mismo formato de entradas, lo que requiere coordinación entre equipos.

Riesgos de Mal Uso¶

- Historial como logging: usar Message History para almacenar información detallada de debugging (stack traces, datos completos) en lugar de metadata ligera de ruta.

- Historial no persistido: confiar solo en el historial transportado por el mensaje sin persistirlo. Si el mensaje se pierde, el historial se pierde.

- Exposición de arquitectura interna: el historial revela la cadena de componentes internos. Si el mensaje es accesible externamente, esto puede ser un riesgo de seguridad.

Sobreingeniería¶

- Historial en flujos simples: en un flujo de 2 saltos (productor → consumidor), Message History es overhead innecesario.

- Metadata excesiva por entrada: incluir información detallada en cada entrada cuando solo se necesita componente + timestamp.

Anti-Patterns Relacionados¶

- Unbounded History: historial que crece sin límite en flujos con loops o recursión, consumiendo cada vez más espacio en el mensaje.

- History as Business Data: usar el historial de routing como input para decisiones de negocio, acoplando la lógica de negocio a la infraestructura de integración.

13. Relación con Otros Patrones¶

Patrones Complementarios¶

- Wire Tap (este capítulo): el Wire Tap puede capturar mensajes con su historial completo para análisis.

- Message Store (este capítulo): el historial persistido en un Message Store permite consultas históricas.

- Control Bus (este capítulo): para activar/desactivar la captura de historial detallado dinámicamente.

- Correlation Identifier (Capítulo 4): el ID de correlación identifica el mensaje; el historial registra su ruta.

Patrones que Suelen Aparecer Juntos¶

- Message History + Wire Tap: capturar mensajes con historial para auditoría centralizada.

- Message History + Message Store: persistir mensajes con su historial completo para replay y análisis.

- Message History + Correlation Identifier: el correlation ID agrupa mensajes relacionados; el historial traza la ruta de cada uno.

Diferencias con Patrones Similares¶

- vs. Wire Tap: Wire Tap copia el contenido del mensaje; Message History registra la ruta del mensaje. Son complementarios, no alternativos.

- vs. Correlation Identifier: el Correlation ID identifica un mensaje o grupo de mensajes; Message History registra qué le pasó.

- vs. Message Store: Message Store persiste el mensaje en un punto; Message History registra todos los puntos por los que pasó.

Encaje en un Flujo Mayor de Integración¶

Message History es un patrón transversal que se aplica a cada mensaje individualmente. Cada componente del flujo tiene la responsabilidad de añadir su entrada. El historial completo se materializa al final del flujo y puede persistirse para consulta posterior.

14. Relevancia Actual del Patrón¶

Evaluación: Relevancia Alta¶

Argumentación¶

Message History es la base conceptual del distributed tracing, que es uno de los pilares de la observabilidad moderna:

- OpenTelemetry: el estándar de facto para distributed tracing. Cada span es una entrada de historial. El trace context (trace-id, span-id, parent-span-id) se propaga en headers — exactamente como Message History propaga entradas en headers del mensaje.

- W3C Trace Context: el estándar W3C para propagación de contexto de tracing a través de HTTP headers (

traceparent,tracestate). Es la estandarización del mecanismo de Message History. - Jaeger/Zipkin/Tempo: backends de tracing que almacenan y visualizan traces distribuidos — el equivalente moderno del Audit Store donde se persiste el Message History.

- Correlation ID en Kafka: la propagación de headers como

correlation-id,trace-iden mensajes de Kafka es Message History en su forma más básica. - Audit Logs regulatorios: en industrias reguladas (finanzas, salud, farmacéutica), el historial de procesamiento de cada mensaje es un requisito legal.

Cómo Se Implementa Hoy¶

| Tecnología | Implementación de Message History | Mecanismo |

|---|---|---|

| OpenTelemetry | Spans + Trace Context | Headers HTTP/gRPC, Kafka headers |

| Kafka | Record Headers | Key-value headers propagados con el mensaje |

| Apache Camel | Message History component | Automático para todas las rutas Camel |

| Spring Integration | MessageHistory header | Header history con lista de componentes |

| AWS X-Ray | Trace segments + subsegments | Header X-Amzn-Trace-Id |

| Azure Application Insights | Dependency tracking | Header Request-Id (W3C compatible) |

Qué Parte Sigue Siendo Esencial¶

- La propagación de contexto de trazabilidad con el mensaje es un requisito universal en sistemas distribuidos.

- La capacidad de reconstruir la ruta completa de un mensaje es fundamental para debugging y compliance.

- La medición de latencia por componente es esencial para optimización de rendimiento.

15. Implementación en Arquitecturas Modernas¶

OpenTelemetry Tracing¶

// Cada componente crea un span (entry de historial)

Span span = tracer.spanBuilder("validation-service")

.setSpanKind(SpanKind.CONSUMER)

.setAttribute("component.instance", "val-eu-02")

.setAttribute("validation.result", "pass")

.setAttribute("message.id", messageId)

.startSpan();

try (Scope scope = span.makeCurrent()) {

// Procesar mensaje

validateMessage(message);

span.setAttribute("validation.checks", 3);

} finally {

span.end(); // Registra duration automáticamente

}

Apache Camel (Message History automático)¶

// Camel registra automáticamente Message History para cada ruta

from("kafka:notifications.inbound")

.routeId("validation")

.process(validationProcessor)

.to("direct:enrichment");

// El mensaje automáticamente contiene:

// Exchange.MESSAGE_HISTORY = [

// {routeId: "validation", processorId: "validationProcessor", timestamp: ...}

// ]

Kafka Headers para Message History¶

// Productor: inicializa historial

ProducerRecord<String, String> record = new ProducerRecord<>(topic, value);

record.headers().add("X-Message-History",

"[{\"component\":\"sms-producer\",\"ts\":\"2026-04-07T14:32:15Z\"}]".getBytes());

// Cada consumidor-productor: añade su entrada

ConsumerRecord<String, String> received = ...;

List<HistoryEntry> history = parseHistory(received.headers());

history.add(new HistoryEntry("validation-service", Instant.now(), "validated"));

ProducerRecord<String, String> forwarded = new ProducerRecord<>(nextTopic, received.value());

forwarded.headers().add("X-Message-History", serializeHistory(history).getBytes());

Spring Integration Message History¶

@Configuration

@EnableMessageHistory("validationChannel,enrichmentChannel,routingChannel")

public class IntegrationConfig {

// Spring Integration añade automáticamente entradas de historial

// cuando el mensaje pasa por los canales configurados

}

16. Consideraciones de Gobierno y Operación¶

Observabilidad¶

- Dashboard de rutas: visualización de las rutas más frecuentes que toman los mensajes y los tiempos por componente.

- Alertas de ruta anómala: detectar mensajes que no siguen la ruta esperada (falta un componente en el historial).

- Métricas de latencia por componente: extraer latencia por componente del historial y agregar en dashboards.

Estandarización¶

- Definir un formato estándar de entradas de historial que todos los componentes deben seguir.

- Mantener un registro de componentes con sus identificadores canónicos.

- Validar que los componentes nuevos implementan Message History antes de desplegarlos.

Retención¶

- Definir durante cuánto tiempo se persiste el historial de los mensajes.

- Alinear la retención con requisitos regulatorios (7 años en finanzas, 10 años en salud en algunos países).

Seguridad¶

- Redactar información sensible de las entradas de historial antes de exponerlas externamente.

- Controlar quién puede consultar los historiales persistidos.

- No incluir en el historial datos de credenciales, tokens o secretos usados por los componentes.

Performance¶

- Limitar el tamaño de las entradas de historial (solo metadata, no datos completos).

- Considerar compresión del historial si el tamaño se convierte en un problema.

- Evaluar el impacto en throughput de añadir entradas en flujos de alto volumen.

17. Errores Comunes¶

Historial Incompleto¶

El error más común: algunos componentes no implementan Message History, creando gaps en la cadena. Mitigación: hacer la implementación de Message History un requisito de deployment (validar en CI/CD).

Historial como Dump de Debugging¶

Usar las entradas de historial para almacenar información detallada de debugging (stack traces, payloads completos). Esto infla el tamaño del mensaje y viola el principio de metadata ligera. El historial debe contener metadata de ruta (quién, cuándo, qué decisión), no información de debugging.

No Persistir el Historial¶

Confiar únicamente en que el historial viaja con el mensaje. Si el mensaje se pierde (dead-letter, expiración), el historial se pierde. El historial debe persistirse en un store de auditoría al final del flujo (o en puntos intermedios para flujos largos).

Formato Inconsistente¶

Cada equipo define su propio formato de entradas de historial. Cuando se intentan correlacionar, los campos no coinciden, los timestamps usan formatos diferentes y los identificadores de componente son ambiguos.

Ignorar el Fan-out¶

Cuando un mensaje se divide (Splitter, Recipient List), cada sub-mensaje necesita heredar el historial del padre y documentar el punto de división. Sin esta herencia, los sub-mensajes pierden la trazabilidad de su origen.

No Calcular Latencia por Componente¶

Tener timestamps en cada entrada de historial pero no calcular ni reportar la latencia entre entradas consecutivas desperdicia información valiosa para optimización de rendimiento.

18. Conclusión Técnica¶

Message History es el patrón que transforma la trazabilidad de mensajes de un ejercicio de arqueología de logs a una consulta directa al propio mensaje. Al incorporar la ruta como parte del mensaje, proporciona trazabilidad auto-contenida, portable y verificable.

Cuándo aporta valor: en flujos de integración con múltiples saltos donde la trazabilidad es un requisito operacional o de compliance. El valor es máximo cuando los incidentes de "¿dónde está mi mensaje?" son frecuentes y costosos de investigar.

Cuándo evita problemas importantes: Message History evita la dependencia de correlación manual de logs para reconstruir rutas de mensajes. También evita conflictos entre equipos al proporcionar evidencia objetiva de la ruta del mensaje. Y satisface requisitos de compliance al ofrecer prueba verificable de procesamiento por cada componente.

Cuándo no conviene adoptarlo: en flujos simples de 1-2 saltos donde la correlación de logs es trivial. Cuando ya existe un sistema de distributed tracing (OpenTelemetry) que captura la misma información de forma externa — en este caso, el tracing externo puede ser preferible al historial embebido, siempre que el sistema de tracing sea confiable y esté siempre disponible.

Recomendación para arquitectos: implemente Message History como infraestructura compartida, no como decisión de cada equipo. Defina un formato estándar de entradas, proporcione librerías que lo implementen automáticamente, y haga la implementación un requisito de deployment. Persista el historial al final de cada flujo para consulta posterior. Y conecte el historial con su sistema de distributed tracing — en la práctica moderna, Message History y distributed tracing son la misma disciplina aplicada a diferentes niveles de abstracción.